Хитри измамници точат лични данни от наивници във фейсбук по този подъл начин

Новата схема за измама в социалните мрежи набира скорост

С развитието на изкуствения интелект (ИИ) нарастват не само възможностите за неговото приложение, но и рисковете, свързани с измамни практики. Киберпрестъпници от различни точки на света вече използват ИИ за създаване на фалшиви профили и манипулативни публикации, чрез които източват лични данни на нищо неподозиращи потребители, сигнализираха читатели на Флагман.бг.

Как работи измамата?

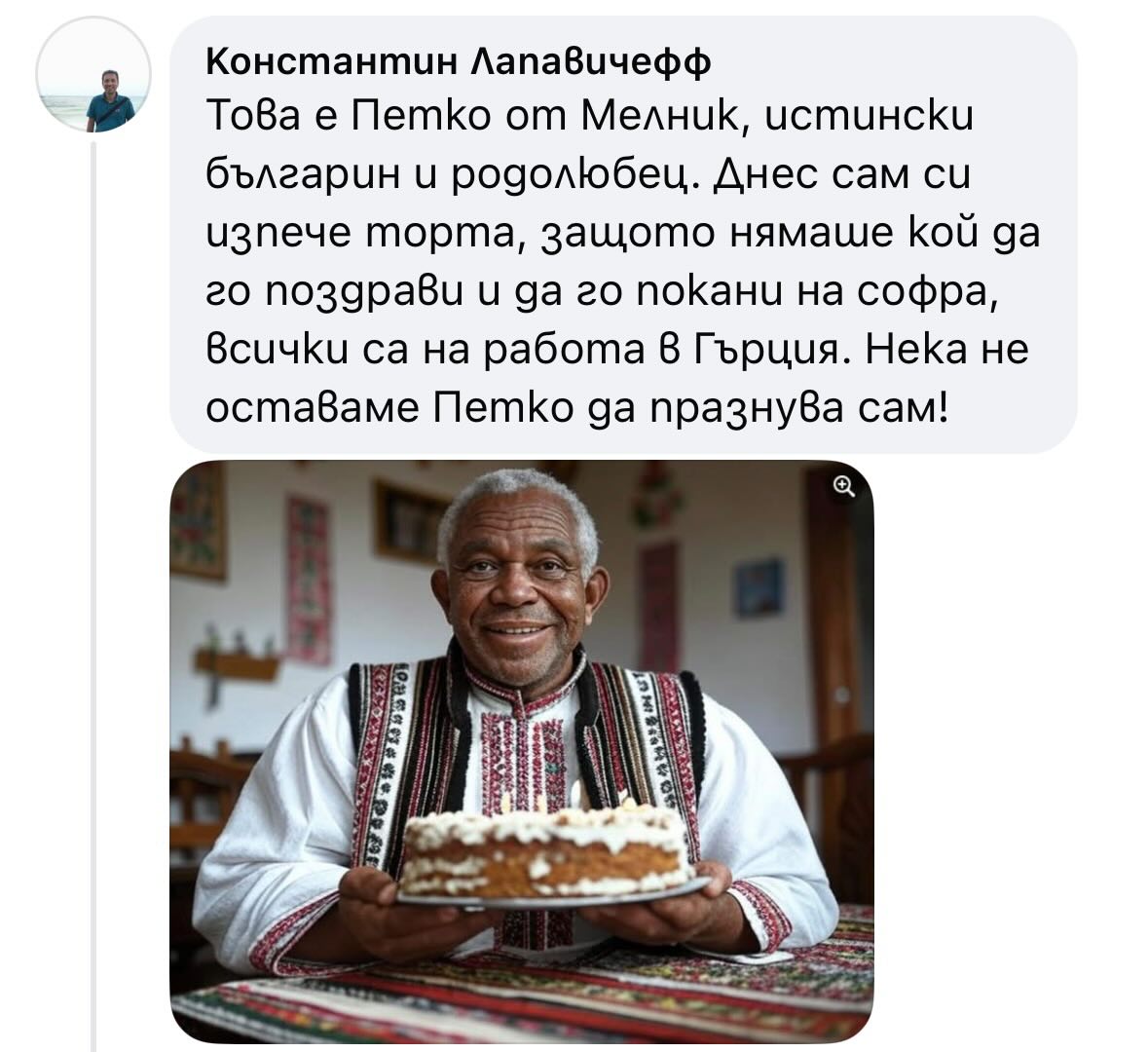

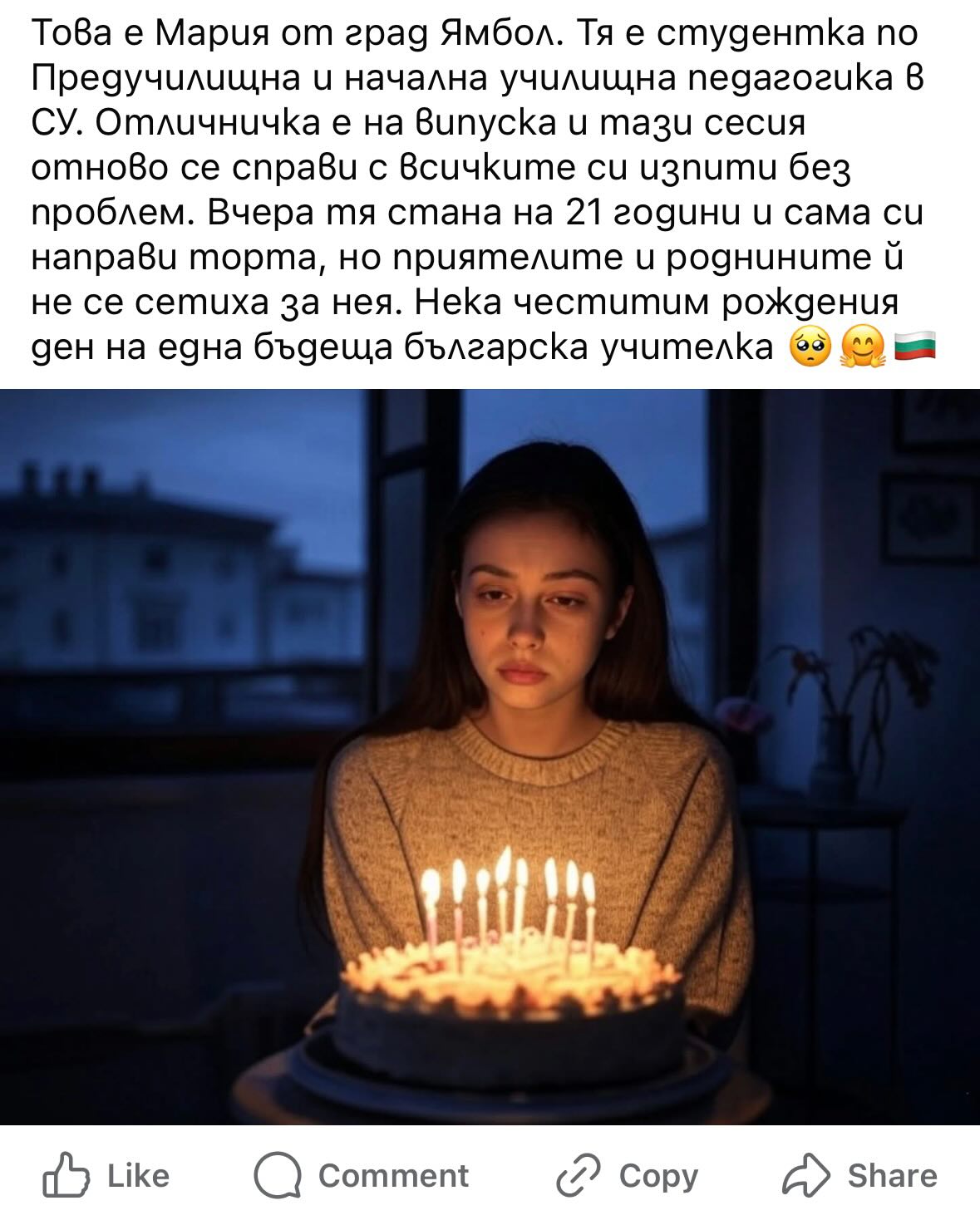

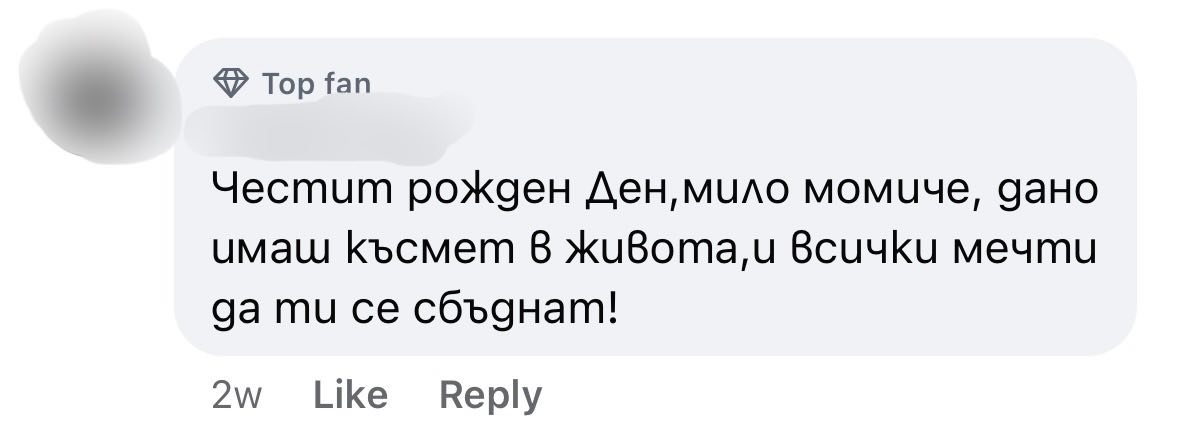

Новата схема е внимателно разработена и разчита на човешката емоционалност и съпричастност. Използвайки генеративен изкуствен интелект, измамниците създават реалистични изображения на несъществуващи хора – „жертви“ без приятели, семейство или близки. Тези фалшиви профили публикуват емоционално натоварени постове, често свързани с рожден ден или самота, с цел да предизвикат съчувствие сред потребителите на социалните мрежи.

Заблудени от правдоподобните снимки и трогателните истории, хората започват да пишат коментари с пожелания и съчувствени думи. Именно тези коментари се използват от измамниците като първоначален филтър – те анализират профилите на отзовалите се потребители, за да идентифицират най-уязвимите жертви.

Следващата стъпка в измамната схема включва директен контакт с тези хора чрез лични съобщения, в които киберпрестъпниците изпращат злонамерени линкове. Ако потребителят последва линка, измамниците могат да получат достъп до личните му данни – дебитни карти, снимки, контакти, а в някои случаи дори пълен контрол над мобилното устройство. Това означава, че престъпниците могат да следят в реално време местоположението на жертвата, нейните разговори и дори да активират камерата на телефона й без знанието й.

Защо хората стават жертви?

Тази нова измамна практика разчита на ниската дигитална грамотност на част от потребителите, особено сред по-възрастните и самотни хора. Много от тях смятат, че си общуват с реален човек, а от съчувствие и емпатия коментират и дори започват комуникация с фалшивия профил.

Киберпрестъпниците използват напреднали технологии, за да създават тези измамни профили и публикации за броени секунди. Обикновено извършителите дори не се намират в държавата на своите жертви – те използват автоматизирани процеси за разпространение на съдържанието на различни езици, адаптирайки го спрямо културните и социалните характеристики на конкретния регион.

Как да се предпазите?

-

Не коментирайте подозрителни публикации – ако видите пост на човек, който изглежда „твърде истински“, но няма никакви приятели, активност или история в социалните мрежи, вероятно е измама.

-

Не отваряйте линкове от непознати профили – най-често атаките започват с лично съобщение, съдържащо зловредна връзка.

-

Проверявайте профилите – ако даден човек няма никаква активност освен публикацията, която предизвиква съчувствие, бъдете подозрителни.

-

Сигнализирайте за съмнителни профили – повечето социални мрежи разполагат с инструменти за докладване на фалшиви акаунти.

-

Обърнете се към институции – ако сте станали жертва на подобна измама или сте подали лични данни, свържете се с компетентни органи като ГДБОП.

Ако сте станали свидетел на подобна измама, можете да сигнализирате в нашата рубрика „Вашият сигнал до Флагман“.

Бургас развива нов модел за растеж чрез образование, индустрия и високотехнологични инвестиции

Бургас развива нов модел за растеж чрез образование, индустрия и високотехнологични инвестиции

Откриха тяло на сърна в двор на къща

Откриха тяло на сърна в двор на къща

Краят на футболната анонимност

Краят на футболната анонимност

Бургас развива нов модел за растеж чрез образование, индустрия и високотехнологични инвестиции

Бургас развива нов модел за растеж чрез образование, индустрия и високотехнологични инвестиции

10/06/2026, Сряда 13:13

0

10/06/2026, Сряда 13:13

0

Нотариуса е изнудвал с компромати магистрати и данъчни

Нотариуса е изнудвал с компромати магистрати и данъчни

Пияна жена гърмя с пушката на мъжа си, арестуваха я

Пияна жена гърмя с пушката на мъжа си, арестуваха я

Митрофанова с първи коментар: София не е променила коренно позицията си към Москва

Митрофанова с първи коментар: София не е променила коренно позицията си към Москва

Масова стрелба край Йоханесбург: Нападатели убиха 12 души

Масова стрелба край Йоханесбург: Нападатели убиха 12 души

Омбудсманът поиска проверка от МОН как се е провела втората задължителна матура

Омбудсманът поиска проверка от МОН как се е провела втората задължителна матура

Как ФИФА обяви война на пластмасата и принуди американските стадиони да станат оранжерии

Как ФИФА обяви война на пластмасата и принуди американските стадиони да станат оранжерии

Директорът на "Евровизия": Ще видим еуфория в България, каквато рядко се вижда

Директорът на "Евровизия": Ще видим еуфория в България, каквато рядко се вижда

И Радев потвърди: Военната помощ за Украйна спира, дали сме достатъчно

И Радев потвърди: Военната помощ за Украйна спира, дали сме достатъчно

От маскирани кечисти до холивудски тиктокъри – кои ще бъдат най-странните фенове на Мондиал 2026

От маскирани кечисти до холивудски тиктокъри – кои ще бъдат най-странните фенове на Мондиал 2026

Тези същите и гласуват ….